- LA SEÑAL

- Posts

- DeepSeek vuelve con una IA capaz de arrasar en la Olimpiada Internacional de Matemáticas

DeepSeek vuelve con una IA capaz de arrasar en la Olimpiada Internacional de Matemáticas

ADEMÁS: Crea fotos de producto para Instagram con Nano Banana Pro

La gran ballena ha vuelto — esta vez con un reasoner de código abierto que alcanza un rendimiento de medalla de oro en una de las competiciones matemáticas más duras del planeta.

Pero lo realmente importante es lo que esto desbloquea: la capacidad de razonamiento más avanzada, antes reservada a laboratorios privados, ahora queda al alcance de cualquiera. Por primera vez, cualquiera puede tener en sus manos el “cerebro” de un matemático de élite

Want to get the most out of ChatGPT?

ChatGPT is a superpower if you know how to use it correctly.

Discover how HubSpot's guide to AI can elevate both your productivity and creativity to get more things done.

Learn to automate tasks, enhance decision-making, and foster innovation with the power of AI.

DeepSeek acaba de presentar DeepSeek-Math-V2, un modelo MoE de código abierto que alcanza rendimiento de medalla de oro en la IMO 2025 y que pone al alcance de todos un nivel de razonamiento matemático “de investigación” que hasta ahora estaba encerrado en sistemas propietarios.

Los detalles:

El modelo logró 118/120 en la competición Putnam 2024 (superando la mejor puntuación humana) y resolvió 5 de los 6 problemas de la IMO 2025, alcanzando el nivel de oro.

En IMO ProofBench obtuvo un 61,9%, prácticamente igualando al Gemini Deep Think de Google —el modelo especializado que ganó el oro— y dejando muy atrás a GPT-5, que se quedó en solo un 20%.

Math-V2 funciona con un sistema de generador-verificador, donde un modelo propone una demostración y otro la analiza, en lugar de limitarse a premiar únicamente la respuesta final.

El verificador asigna puntuaciones de confianza a cada paso, obligando al generador a pulir los razonamientos débiles y garantizando una depuración constante del proceso lógico.

Por qué es importante: Al liberar un modelo que compite de tú a tú con la joya interna de Google, DeepSeek rompe el monopolio del razonamiento matemático más avanzado y ofrece a la comunidad una base sobre la que construir agentes capaces de revisar y corregir su propio pensamiento. Esto podría transformar campos como la ingeniería, donde equivocarse sale caro.

OpenAI ha revelado que su proveedor de analíticas, Mixpanel, sufrió un incidente de seguridad en el que un atacante exportó parte de la información de perfil de usuarios de su API —aunque no se vieron comprometidos chats, claves de API, datos de pago ni credenciales.

Los detalles:

La brecha ocurrió el 9 de noviembre, afectando a los sistemas de Mixpanel que ofrecían análisis web en la interfaz de la API de OpenAI.

Los datos exportados por el atacante incluían información de perfil vinculada al producto API, como nombres, correos electrónicos, ubicaciones (ciudad/estado) y detalles de dispositivos.

OpenAI confirmó que los usuarios de ChatGPT y otros productos no se vieron afectados, y que no se filtraron chats, datos de API, credenciales ni información de pago.

La compañía eliminó Mixpanel de sus sistemas y está notificando directamente a los usuarios afectados, además de recomendar precaución ante posibles intentos de phishing que puedan aprovechar los datos filtrados.

Por qué importa: Aunque las defensas de OpenAI funcionaron, este incidente recuerda los riesgos de seguridad que pueden introducir los socios externos. Para los usuarios de la API afectados, el peligro inmediato no es la pérdida de cuentas, sino posibles ataques de ingeniería social, donde los atacantes podrían usar los correos filtrados para causar problemas adicionales.

Accede a contenido exclusivo cada día.

En la versión PRO de esta newsletter recibes un reporte diario con las noticias más relevantes, herramientas que aún no conoces, y recursos exclusivos: desde cursos hasta guías prácticas para instalar modelos de IA en tu ordenador.

NVIDIA y la Universidad de Hong Kong han publicado un estudio que sugiere que el futuro de la IA podría no depender de escalar modelos, sino de una orquestación más inteligente, con su nueva herramienta entrenando modelos pequeños capaces de superar a la IA más avanzada a una fracción del coste.

Los detalles:

ToolOrchestra entrena un modelo “orquestador” que decide cuándo razonar internamente y cuándo recurrir a herramientas y modelos especializados, según la tarea.

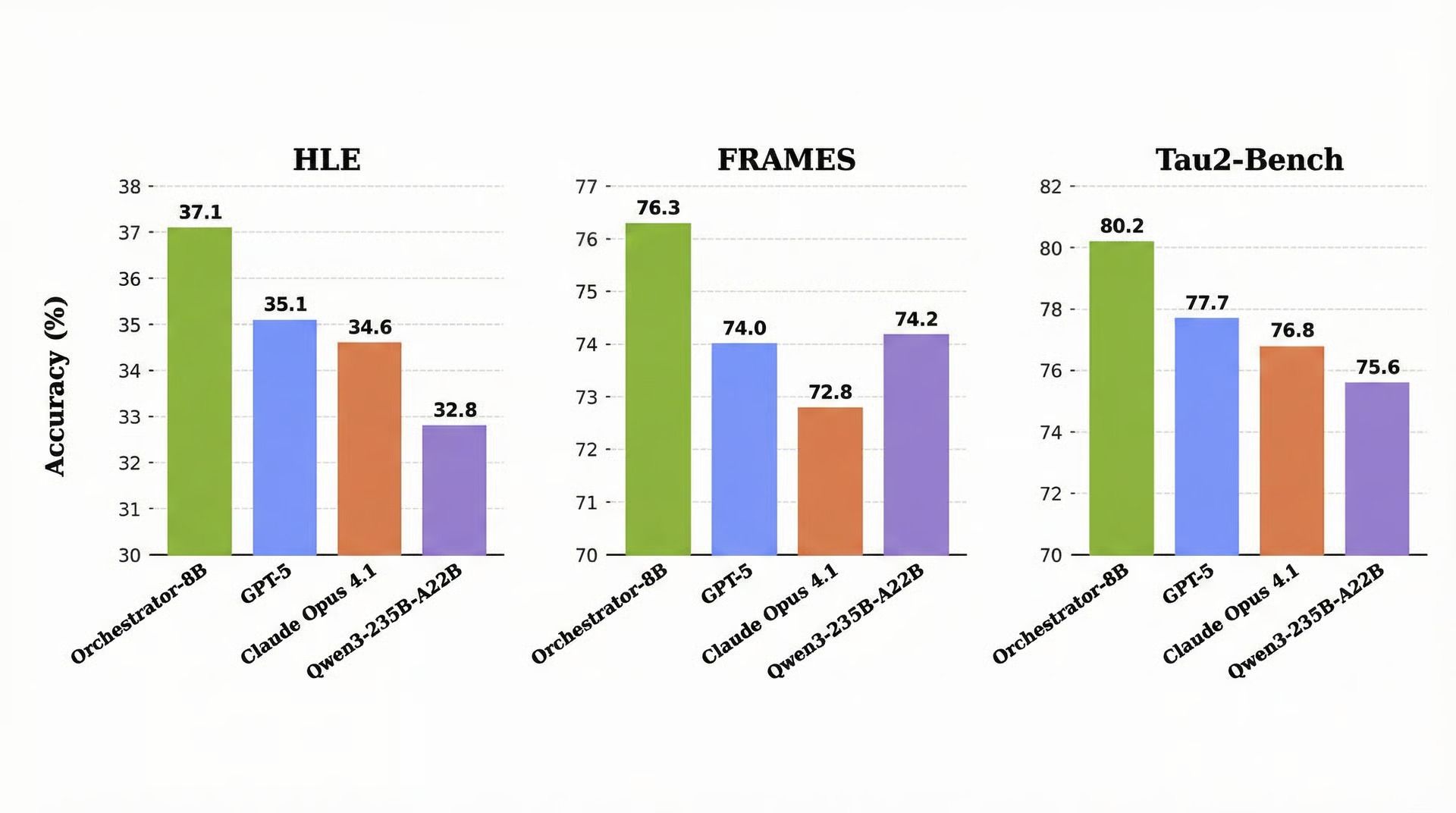

Un modelo de 8B entrenado con este sistema superó a GPT-5 y Claude Opus 4.1 en Humanity’s Last Exam, con un 37,1%, siendo 2,5 veces más eficiente y rápido.

Incluso al probarlo con herramientas nuevas, el orquestador se adaptó bien, demostrando su capacidad para trabajar con conjuntos de herramientas y estructuras de precios cambiantes.

Los agentes anteriores solían sobreutilizar las herramientas y modelos más potentes (y caros), pero ToolOrchestra evita esto mediante una orquestación dirigida de modelos y herramientas.

Por qué importa: Siguiendo los comentarios recientes de Ilya Sutskever, ToolOrchestra desafía la idea de que “más grande es mejor”. En lugar de un sistema gigantesco, NVIDIA muestra que pequeños modelos coordinando herramientas podrían ser el camino a seguir. Si la orquestación supera a la escalabilidad, el modelo o director de herramientas más inteligente será el próximo gran avance en IA.