- LA SEÑAL

- Posts

- Gemini 2.0 se vuelve Pro

Gemini 2.0 se vuelve Pro

PLUS: El Copilot Cowork de Microsoft, impulsado por Claude

Hace apenas unos meses, Anthropic era uno de los socios de inteligencia artificial más destacados del Pentágono. Ahora se enfrenta al gobierno en los tribunales federales.

Con dos nuevas demandas que cuestionan la etiqueta de "riesgo en la cadena de suministro" y la directiva de la Casa Blanca para romper lazos, Anthropic argumenta que está siendo objeto de represalias por haber alzado la voz en materia de seguridad — y más de 30 empleados de OpenAI y Google ya se están posicionando a su lado.

Become An AI Expert In Just 5 Minutes

If you’re a decision maker at your company, you need to be on the bleeding edge of, well, everything. But before you go signing up for seminars, conferences, lunch ‘n learns, and all that jazz, just know there’s a far better (and simpler) way: Subscribing to The Deep View.

This daily newsletter condenses everything you need to know about the latest and greatest AI developments into a 5-minute read. Squeeze it into your morning coffee break and before you know it, you’ll be an expert too.

Subscribe right here. It’s totally free, wildly informative, and trusted by 600,000+ readers at Google, Meta, Microsoft, and beyond.

Anthropic lleva al gobierno de EE.UU. a los tribunales

El Copilot Cowork de Microsoft, impulsado por Claude

a16z publica su nuevo Top 100 de IA para consumidores

Anthropic ha respondido a la administración Trump con dos demandas judiciales, cuestionando la etiqueta de "riesgo en la cadena de suministro" del Pentágono y la directiva de la Casa Blanca para que todos los organismos federales abandonen Claude — una medida que la compañía califica de castigo por sus posturas en materia de seguridad de la IA.

Los detalles:

Anthropic presentó demandas en dos tribunales distintos, pidiendo a los jueces que anulen la clasificación de lista negra e impidan al gobierno obligar a las agencias a cortar relaciones con la empresa.

Las demandas argumentan que la etiqueta de "riesgo en la cadena de suministro" fue creada para hacer frente a amenazas de adversarios extranjeros, no para sancionar a una empresa estadounidense por discrepancias políticas.

También alegan que el Pentágono vulneró la libertad de expresión al tomar represalias por defender públicamente límites de seguridad en el uso de la IA en armamento y vigilancia.

Más de 30 empleados de OpenAI y Google firmaron un escrito legal en respaldo a la demanda de Anthropic contra el Pentágono, advirtiendo de que la inclusión en listas negras pone en riesgo el liderazgo de EE.UU. en IA.

Por qué importa:

Independientemente de la postura que se tome sobre quién debe controlar la IA en el ámbito militar, la respuesta federal — la lista negra de Hegseth y los posts de Trump en Truth Social — tiene todo el aspecto de una represalia. Gane o pierda, el caso podría determinar si el gobierno tiene potestad para actuar contra una empresa nacional por pronunciarse sobre seguridad, un precedente que todos los laboratorios de IA seguirán de cerca.

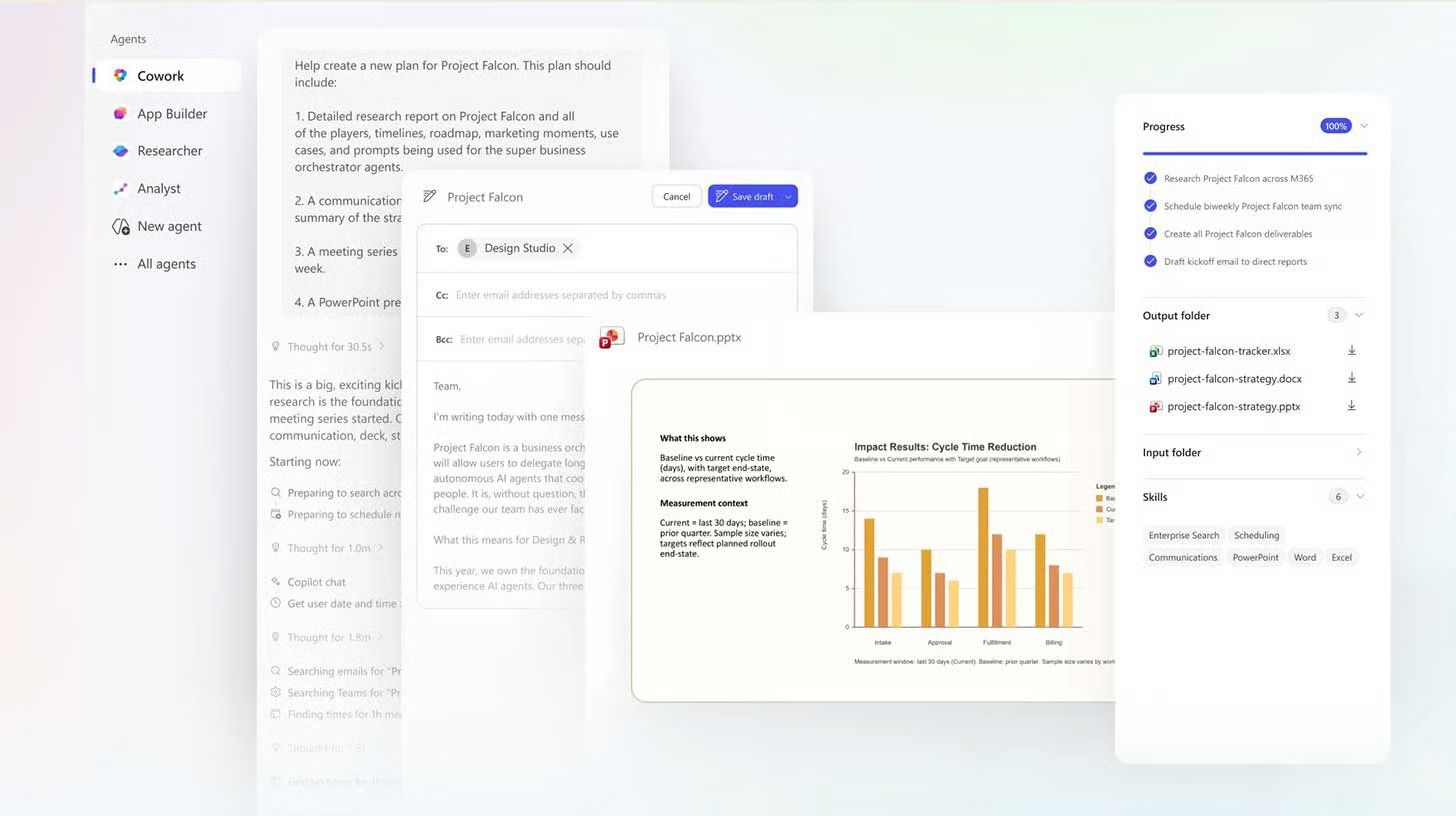

Microsoft acaba de presentar Copilot Cowork, una nueva función de M365 construida sobre el sistema Claude de Anthropic que ejecuta tareas en segundo plano entre distintas aplicaciones — y llega acompañada de un paquete empresarial a 99 dólares y una nueva plataforma para gestionar agentes de IA a gran escala.

Los detalles:

Cowork funciona en la nube, extrayendo información de correos, reuniones, archivos y chats de todo el ecosistema M365 — un enfoque diferente al de Claude Cowork, que actualmente solo opera en escritorio.

Microsoft desarrolló Cowork directamente junto a Anthropic, aprovechando la tecnología de Claude Cowork pero integrada dentro de las capas de seguridad y cumplimiento normativo de M365.

El usuario describe un objetivo y Cowork lo desglosa en pasos, generando entregables como presentaciones, documentos de briefing y hojas de trabajo entre distintas aplicaciones.

Cowork está disponible en una vista previa de investigación limitada, y llega con un nuevo nivel E7 a 99 dólares por usuario que combina Copilot con herramientas de gestión de agentes y seguridad.

Por qué importa:

Si no puedes vencer a lo que asustó a tus inversores, asimílalo. Integrar la tecnología de agentes de Anthropic dentro de los límites de seguridad de M365 le otorga a Copilot Cowork algo que Claude Cowork aún no puede igualar fácilmente: un contexto empresarial profundo e integrado sobre los correos, calendarios y archivos de 450 millones de usuarios.

a16z ha publicado la sexta edición de su Top 100 de IA para consumidores, ampliando la lista por primera vez para incluir aplicaciones tradicionales con IA como Canva y CapCut, junto con datos que muestran que ChatGPT sigue dominando el uso general, aunque sus rivales van recortando distancias.

Los detalles:

ChatGPT superó los 900 millones de usuarios semanales y sigue eclipsando a todos sus competidores, aunque la brecha se estrecha — Claude y Gemini incrementaron sus suscripciones de pago más de un 200% el año pasado.

La nueva lista incluye por primera vez aplicaciones de consumo con "IA integrada", con CapCut, Canva, Notion, Grammarly y otras entrando en el ranking.

El informe detecta la formación de tres ecosistemas de IA diferenciados: occidental, chino y ruso, con las sanciones acelerando la división a medida que las alternativas locales llenan el hueco.

Los agentes ganan terreno, con Manus (nº 44) y Genspark (nº 47) entrando en la lista, mientras que OpenClaw queda fuera por el marco temporal del informe.

Por qué importa:

Los informes de consumo de a16z se han convertido en uno de los mejores termómetros para medir hacia dónde se dirige realmente la adopción de la IA, y esta edición no es una excepción. Teniendo en cuenta el reciente escándalo de OpenAI con el Pentágono, las cancelaciones y el auge de Claude, la batalla por convertirse en la IA de referencia para los usuarios podría ser aún más reñida en la próxima entrega.