- LA SEÑAL

- Posts

- La IA permite que pacientes con parálisis controlen dispositivos robóticos

La IA permite que pacientes con parálisis controlen dispositivos robóticos

ADEMÁS: Diseña y crea una app móvil con Figma AI

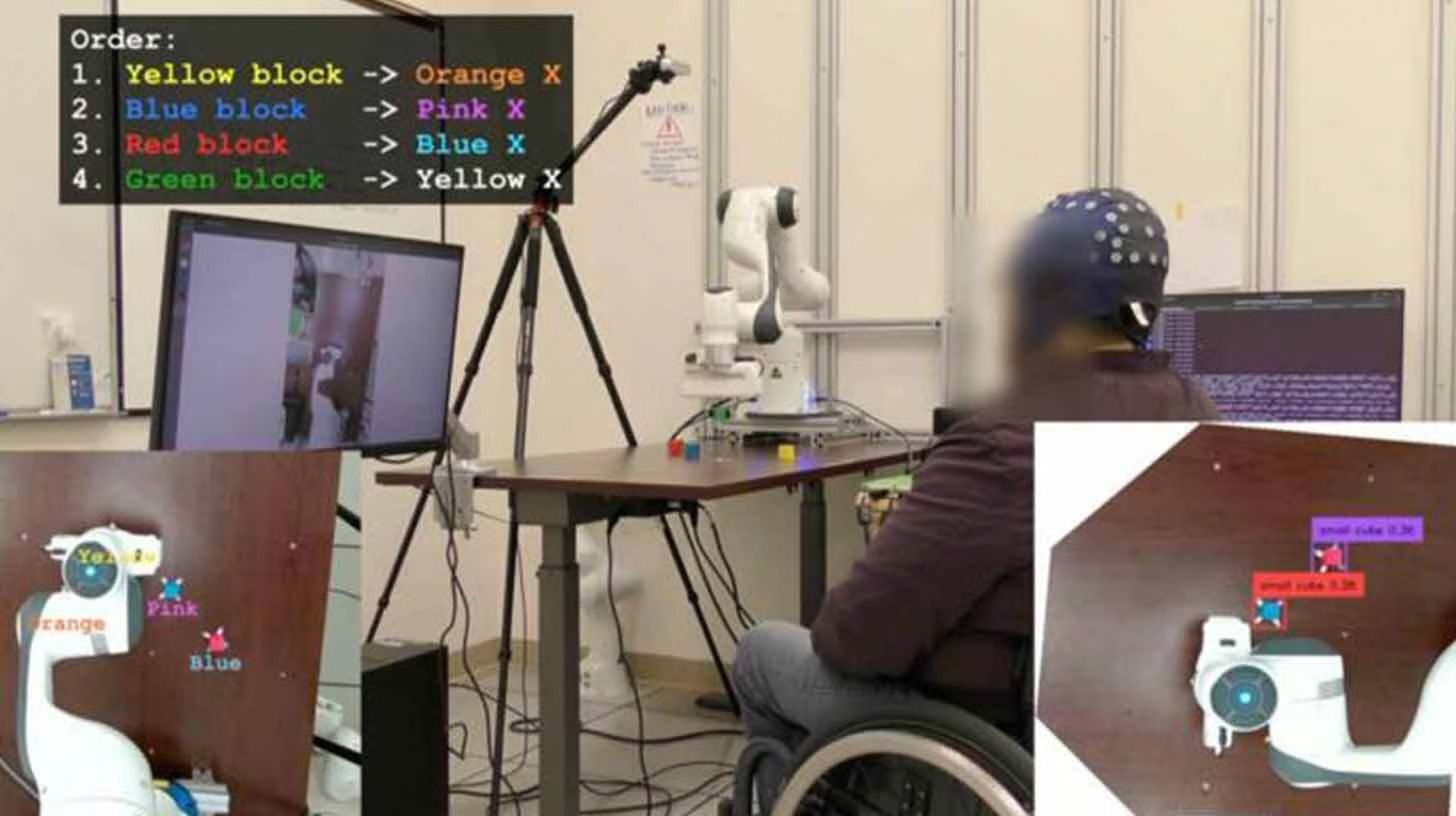

Ingenieros de la UCLA han convertido un casco de EEG convencional en un dispositivo capaz de interpretar la actividad cerebral con la precisión suficiente como para manejar prótesis robóticas.

Al combinarlo con inteligencia artificial que traduce las intenciones en tiempo real, han logrado ofrecer a personas con parálisis unas capacidades que antes solo eran posibles mediante cirugía cerebral, abriendo además la puerta a un futuro cercano de tecnologías asistivas no invasivas.

The Gold standard for AI news

AI keeps coming up at work, but you still don't get it?

That's exactly why 1M+ professionals working at Google, Meta, and OpenAI read Superhuman AI daily.

Here's what you get:

Daily AI news that matters for your career - Filtered from 1000s of sources so you know what affects your industry.

Step-by-step tutorials you can use immediately - Real prompts and workflows that solve actual business problems.

New AI tools tested and reviewed - We try everything to deliver tools that drive real results.

All in just 3 minutes a day

La IA ayuda a pacientes con parálisis a controlar robots

Las palabras de moda de la IA se cuelan en el lenguaje cotidiano

La IA del MIT busca predecir la eficacia de la vacuna contra la gripe

4 nuevas herramientas de inteligencia artificial

Ingenieros de la UCLA han desarrollado una interfaz cerebro-ordenador portátil que utiliza inteligencia artificial para descifrar señales de EEG, permitiendo que personas con parálisis controlen brazos robóticos únicamente con sus pensamientos y sin necesidad de cirugía invasiva.

Los detalles:

El equipo combinó un decodificador de EEG a medida con una IA basada en cámara capaz de interpretar la intención de movimiento del paciente en tiempo real.

El sistema se probó con cuatro participantes, entre ellos una persona paralizada que logró completar tareas robóticas en 6,5 minutos, algo imposible sin esta tecnología.

Los usuarios movieron cursores hacia objetivos y dirigieron brazos robóticos para desplazar bloques, logrando realizar ambas actividades casi cuatro veces más rápido gracias a la ayuda de la IA.

La solución se basa en gorros de EEG convencionales, lo que elimina riesgos quirúrgicos y aun así alcanza niveles de rendimiento comparables a los métodos invasivos.

Por qué es importante: Décadas después de los primeros implantes cerebrales, empiezan a aparecer interfaces no invasivas que realmente funcionan, con la IA cubriendo las lagunas donde las señales neuronales no son suficientes. En el futuro, estos copilotos de IA no solo asistirán en el manejo de prótesis robóticas, sino también en sillas de ruedas, dispositivos de comunicación y hogares inteligentes capaces de anticiparse a las necesidades de las personas incluso antes de que las expresen.

Un nuevo estudio realizado por investigadores de la Universidad Estatal de Florida revela que las palabras de moda en IA han experimentado un aumento masivo en conversaciones de podcasts desde el lanzamiento de ChatGPT en 2022, describiendo estos cambios lingüísticos como un “efecto de infiltración”.

Los detalles:

El estudio analizó 22,1 millones de palabras de contenidos no guionizados, como podcasts, y descubrió que el 75 % de los términos asociados a la IA aumentaron tras la llegada de ChatGPT.

La investigación se centró en podcasts de ciencia y tecnología cuyos presentadores probablemente utilizan ChatGPT de forma habitual, convirtiéndolos en indicadores tempranos de estos cambios lingüísticos.

Entre las palabras destacadas se encontraban “boast” (presumir), “meticulous” (meticuloso) y “delve” (profundizar), atribuidas por expertos al entrenamiento de la IA con grandes volúmenes de contenido corporativo y web.

Un estudio separado en Alemania obtuvo resultados similares, mostrando incrementos en el uso de palabras como “delve” y “meticulous” en contenidos de YouTube y podcasts.

Por qué importa: En solo unos años, la IA ha empezado a remodelar la forma en que los humanos se comunican. Hoy se manifiesta en palabras de moda que aparecen en podcasts, pero mañana se espera que la influencia de la IA sea omnipresente, desde diseños web que reproducen patrones creados por IA hasta desarrolladores que escriben gran parte de su código con plataformas inteligentes.

Accede a contenido exclusivo cada día.

En la versión PRO de esta newsletter recibes un reporte diario con las noticias más relevantes, herramientas que aún no conoces, y recursos exclusivos: desde cursos hasta guías prácticas para instalar modelos de IA en tu ordenador.

Investigadores del MIT han desarrollado VaxSeer, un sistema de IA capaz de predecir qué cepas de la gripe dominarán las próximas temporadas y de identificar con meses de antelación las vacunas más protectoras.

Los detalles:

El sistema utiliza aprendizaje profundo entrenado con décadas de secuencias virales y datos de laboratorio para prever qué cepas serán predominantes y la eficacia potencial de las vacunas.

Al compararlo con temporadas de gripe pasadas, VaxSeer superó las elecciones de vacunas de la OMS en 15 de 20 casos para dos tipos principales de gripe.

Además, identificó una fórmula de vacuna eficaz en 2016 que las autoridades sanitarias no seleccionaron hasta el año siguiente.

Las predicciones de VaxSeer coincidieron estrechamente con la efectividad real de las vacunas administradas a los pacientes.

Por qué importa: Las vacunas deben desarrollarse antes de la temporada de gripe, por lo que elegir la cepa correcta suele ser un juego de azar, con resultados a veces impredecibles. La capacidad de VaxSeer de detectar patrones que los humanos pasan por alto permite mejorar la selección de cepas, lo que podría traducirse en muchas menos enfermedades durante la temporada de gripe.

NUEVAS HERRAMIENTAS

💬 Hunyuan-MT – Pequeño modelo de traducción SOTA de código abierto

🍥 USO – Modelo creativo de ByteDance para generar estilos y temáticas

🗣️ Higgsfield Speak 2.0 – Haz que los avatares hablen con sincronización labial y movimiento

🔊 MAI-Voice-1 – Nuevo modelo de generación de voz desarrollado internamente por Microsoft

NOTICIAS EXPRESS

Honeycomb Observability Day SF, 11 de septiembre – Únete a Charity Majors y Liz Fong-Jones para explorar el futuro de la observabilidad en la era de la IA. Reserva tu plaza.*

Se informa que OpenAI está negociando la construcción de un centro de datos de al menos 1 GW en India como parte de su iniciativa Stagate, y se espera que el CEO Sam Altman visite el país este mes.

Tencent ha lanzado Hunyuan-MT-7B y Hunyuan-MT-Chimera, un sistema conjunto de traducción de IA de código abierto que supera a sus competidores en su categoría de tamaño en 33 idiomas.

El CEO Marc Benioff reveló que Salesforce ha reducido su plantilla de soporte en un 45 % este año, utilizando agentes de IA para gestionar respuestas a clientes y conversaciones de leads.

El presidente chino Xi Jinping habló sobre IA en la Organización de Cooperación de Shanghái, instando a la cooperación global y rechazando la “mentalidad de Guerra Fría” en torno a esta tecnología.