- LA SEÑAL

- Posts

- Meta Superintelligence Labs lanza su primer modelo

Meta Superintelligence Labs lanza su primer modelo

ADEMÁS: Documentos de OpenAI sugieren desarrollo de robots humanoides y hardware para consumidores

El pasado verano, Mark Zuckerberg puso a Alexandr Wang al frente de un laboratorio completamente nuevo, dotado de talento recién fichado a precio de oro procedente de los principales competidores. Hoy hemos tenido el primer vistazo a lo que se ha construido con esa inversión.

El modelo Meta Muse Spark no lidera todos los benchmarks, pero devuelve al gigante tecnológico de lleno a la pelea, con los recursos, los datos y más de 3.000 millones de usuarios diarios sobre los que seguir construyendo.

Learn how to code faster with AI in 5 mins a day

You're spending 40 hours a week writing code that AI could do in 10.

While you're grinding through pull requests, 200k+ engineers at OpenAI, Google & Meta are using AI to ship faster.

How?

The Code newsletter teaches them exactly which AI tools to use and how to use them.

Here's what you get:

AI coding techniques used by top engineers at top companies in just 5 mins a day

Tools and workflows that cut your coding time in half

Tech insights that keep you 6 months ahead

Sign up and get access to the Ultimate Claude code guide to ship 5X faster.

Meta Superintelligence Labs lanza su primer modelo

El Avatar V de HeyGen resuelve el problema de la pérdida de identidad en la IA

Anthropic simplifica el sistema de creación de agentes

El laboratorio Meta Superintelligence Labs acaba de lanzar Muse Spark, un modelo de razonamiento multimodal que supone el debut tan esperado de la división de alto perfil que Alexandr Wang montó el pasado verano.

Los detalles:

Muse Spark procesa entradas de voz, texto e imagen, e incluye un modo de reflexión en el que varios agentes compiten entre sí para resolver problemas complejos.

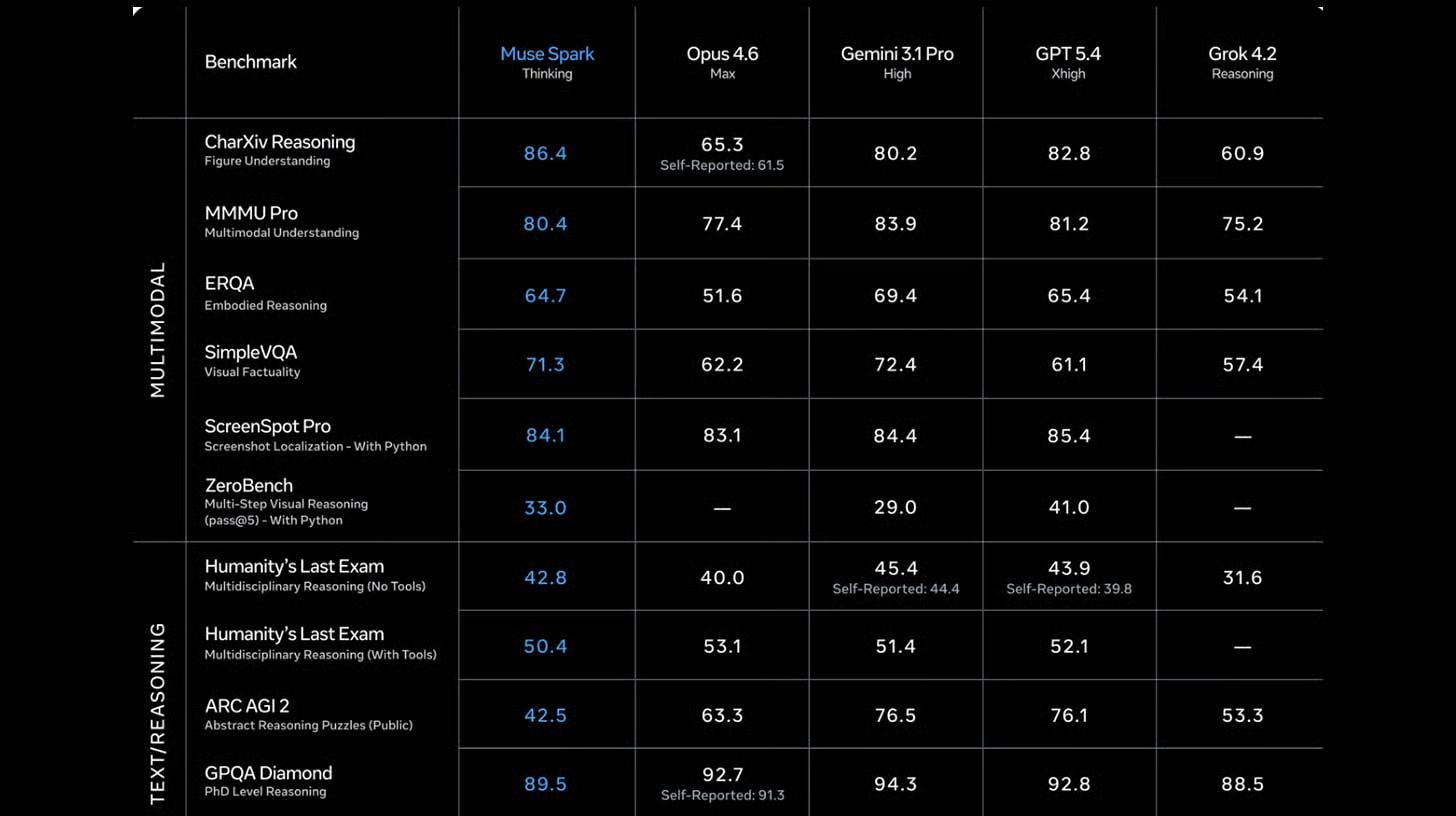

Los resultados del modelo en benchmarks son competitivos frente a rivales de frontera como Opus 4.6 y GPT 5.4 en razonamiento, aunque flojea en codificación y en pruebas como ARC-AGI 2.

Muse Spark destaca especialmente en razonamiento sobre salud, un área que la compañía ha priorizado como parte de su misión de 'superinteligencia personal'. A diferencia de la familia Llama, Muse Spark es un modelo propietario.

Meta ha manifestado su intención de publicar versiones en abierto en el futuro, aunque sin comprometerse a ningún plazo concreto. Wang tomó las riendas de Meta Superintelligence Labs hace 9 meses, tras la adquisición de Scale AI por parte de Zuckerberg por 14.300 millones de dólares, y asegura que el equipo "reconstruyó nuestra infraestructura de IA desde cero".

Por qué importa:

Meta ha vuelto a la partida. Aunque el modelo todavía no alcanza a los líderes del sector, Muse Spark supone un salto cualitativo enorme respecto a donde se encontraba Meta con su familia Llama. Puede que no revolucione el mundo de golpe, pero con recursos casi ilimitados, datos valiosos de sus plataformas y miles de millones de usuarios, los esfuerzos de Meta en IA acaban de dar un paso importante en la dirección correcta.

The World's Biggest Dev Event Hits Silicon Valley

WeAreDevelopers World Congress comes to San José, CA — September 23–25, 2026. 10,000+ developers, 500+ speakers, and the full software development lifecycle under one roof, in the heart of Silicon Valley.

Kelsey Hightower. Thomas Dohmke (fmr. CEO, GitHub). Christine Yen (CEO, Honeycomb). Mathias Biilmann (CEO, Netlify). Olivier Pomel (CEO, Datadog). The people actually building the tools you use every day — all on one stage.

AI, cloud, DevOps, security, architecture, and everything real builders ship with. Workshops, masterclasses, and the official congress party.

HeyGen ha presentado Avatar V, un nuevo modelo al que la compañía califica como "el avatar de IA más realista del mundo", y asegura que es capaz de eliminar la deriva de identidad, es decir, la tendencia que tienen los rostros generados por IA a dejar de parecerse al usuario con el paso del tiempo.

Los detalles:

El sistema genera un avatar de vídeo completo a partir de una grabación de tan solo 15 segundos con el móvil, capturando los rasgos faciales reales del usuario, sus gestos y sus patrones de movimiento.

El modelo también separa por primera vez la identidad del aspecto visual, lo que permite grabar una sola vez y después cambiar de ropa o de fondo sin necesidad de volver a filmar.

HeyGen afirma que Avatar V superó a Veo 3.1 de Google en precisión y sincronización labial en pruebas internas, además de imponerse a Kling y Seedance en tests a ciegas.

Por qué importa:

Al igual que los modelos de imagen y vídeo, los avatares de IA han avanzado una barbaridad en los últimos años, pasando de simples movimientos de boca a imitar los microgestos del usuario para generar resultados prácticamente indistinguibles de los reales. Aunque algunos puedan ver con escepticismo la idea de un "gemelo de IA", el panorama de la creación de contenido está cambiando con ellos o sin ellos.

Accede a contenido exclusivo cada día.

En la versión PRO de esta newsletter recibes un reporte diario con las noticias más relevantes, herramientas que aún no conoces, y recursos exclusivos: desde cursos hasta guías prácticas para instalar modelos de IA en tu ordenador.

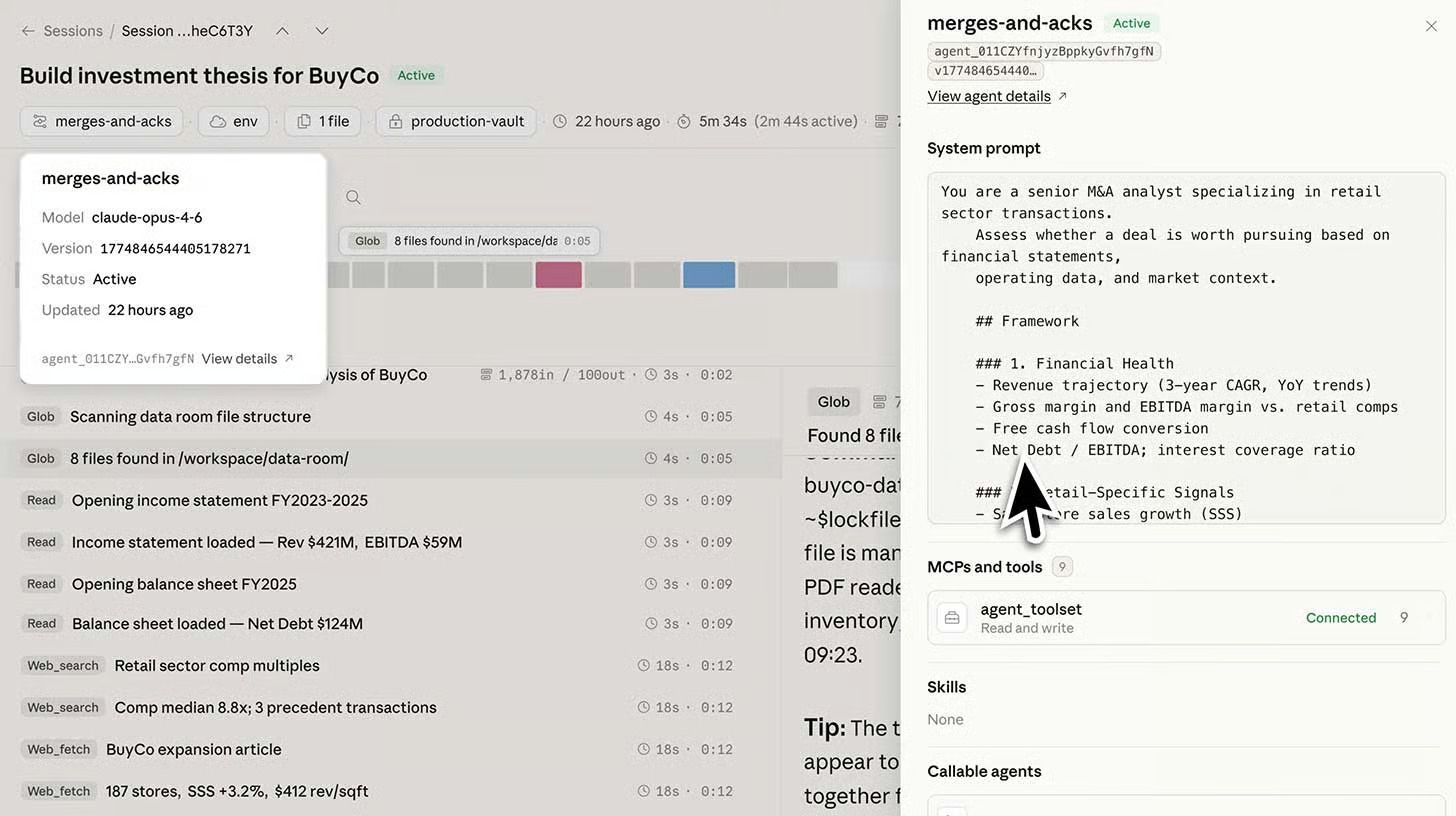

Anthropic ha abierto una beta pública para Claude Managed Agents, una nueva plataforma que permite a los desarrolladores pasar de una idea de agente a un producto en funcionamiento en cuestión de días, encargándose de toda la infraestructura técnica que antes le llevaba meses montar a un equipo de ingenieros.

Los detalles:

El usuario elige la tarea, las herramientas y los límites de actuación, mientras que Managed Agents se ocupa de ejecutar, proteger y controlar a qué puede acceder el sistema agéntico.

Los agentes pueden trabajar de forma autónoma durante horas sin perder el estado de la sesión. Además, hay un modo de coordinación en fase de pruebas que permite a un agente delegar subtareas en otros agentes.

Notion, Rakuten, Asana y Sentry son algunos de los primeros en adoptarlo, y según se informa, Rakuten logró desplegar agentes en cinco departamentos en aproximadamente una semana por departamento.

Cada sesión de agente tiene un coste de 0,08 dólares por hora, sumado a la tarifa habitual de uso de la IA, con un modelo de pago por consumo en lugar de cuotas fijas por plataforma.

Por qué importa:

Anthropic sigue lanzando funcionalidades que eliminan las complejidades a la hora de sacar el máximo partido a sus modelos y herramientas. Managed Agents hace ahora lo mismo: simplifica el proceso de construcción agéntica y hace posible que cualquiera pueda desplegar y controlar agentes sin los típicos quebraderos de cabeza técnicos.